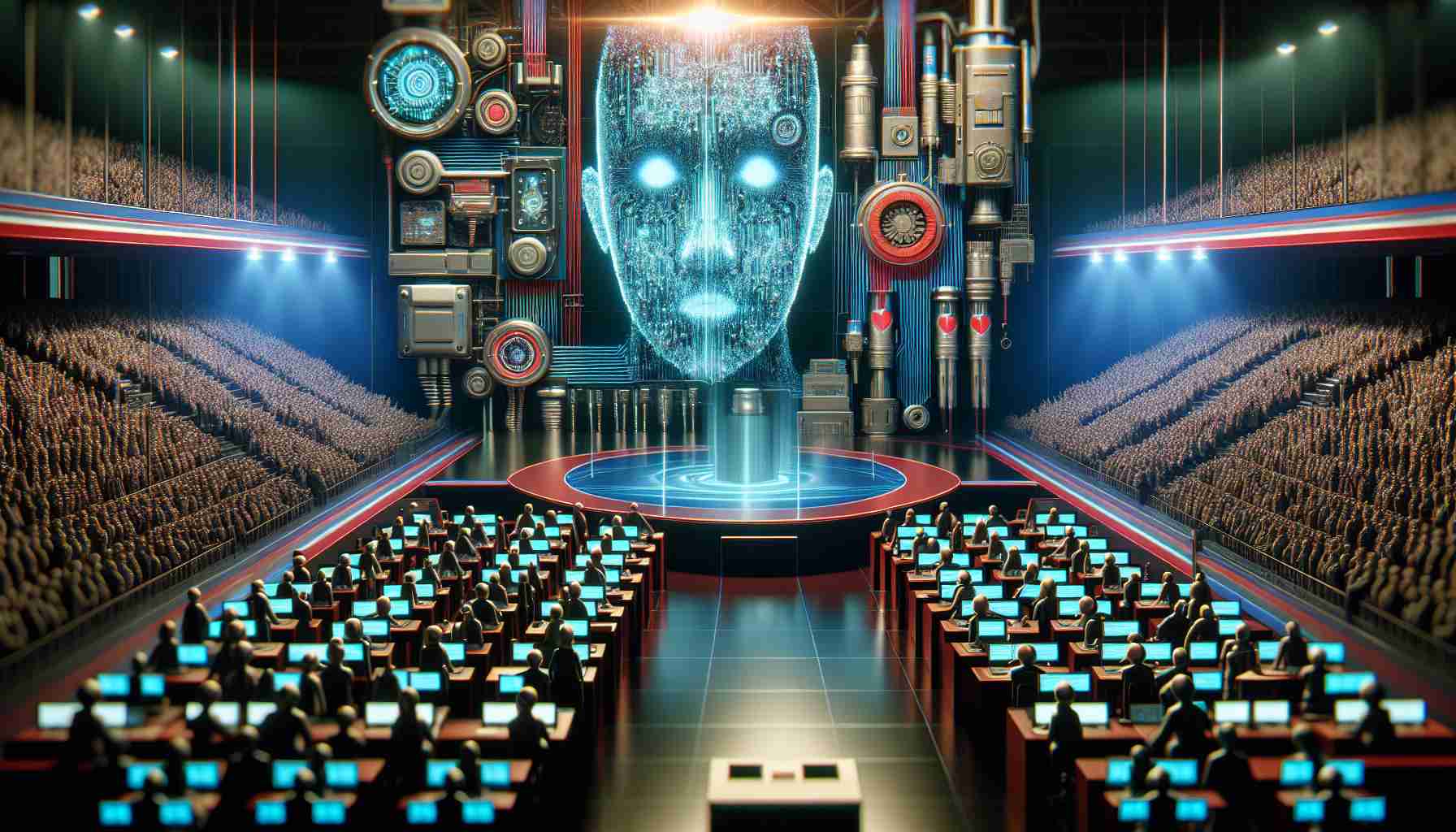

С приближением выборов в США в 2024 году сделан значительный шаг вперед в идентификации голосов, сгенерированных с помощью deepfake. Hiya, компания, известная своими возможностями проверки звонков и обнаружения мошенничества, представила бесплатное расширение для Chrome, предназначенное для помощи пользователям в оценке подлинности голосов, встречающихся в аудио- и видео-контенте. Это расширение, названное Hiya Deepfake Voice Detector, анализирует аудиовходы и предоставляет оценку, указывающую на вероятность того, что голос является реальным или поддельным.

Согласно Hiya, обширные тестирования показали, что этот инструмент обладает впечатляющей точностью, превышающей 99 процентов. Датчик может распознавать голоса, синтезированные с помощью современных технологий ИИ, даже если они ранее не встречались в модели.

В предварительных испытаниях пользователи обнаружили, что расширение эффективно выделяет голоса, сгенерированные ИИ. Например, в популярном видео на YouTube, в котором рассматривается сегмент, озвученный ИИ о легенде блюза Хоулине Уолфе, был получен низкий рейтинг подлинности, подтверждающий подозрения о манипуляциях.

Руководство Hiya раскритиковало социальные сети за то, что они недостаточно ответственны в предупреждении пользователей о потенциально вводящем в заблуждение контенте. Компания подчеркивает, что крайне важно, чтобы люди осознавали риски, связанные с манипуляцией ИИ, и использовали такие инструменты, как их Deepfake Voice Detector для защиты. Хотя расширение предоставляет ежедневные кредиты для управления использованием, его ограниченная квота может не справляться с потоком аудио, сгенерированного ИИ, который, вероятно, возрастет в социальных сетях в ближайшем будущем.

Новый инструмент для борьбы с голосами deepfake выпущен перед выборами: решение новых проблем

С приближением выборов в США в 2024 году распространение технологий deepfake вызывает серьезные опасения относительно целостности политического дискурса. В ответ Hiya представила свой Hiya Deepfake Voice Detector, инструмент, который не только направлен на защиту пользователей от манипуляции аудиоконтентом, но и поднимает важные вопросы о последствиях таких технологий в современном обществе.

Ключевые вопросы, связанные с технологией deepfake

1. Насколько распространена технология deepfake в политических кампаниях?

Аудио deepfake влияет на политический дискурс, потенциально подрывая доверие к реальным сообщениям кандидатов. Аналитики прогнозируют увеличение использования deepfake перед выборами, что делает инструменты, такие как детектор Hiya, критически важными для различения истины и фальсификации.

2. Каковы правовые последствия использования таких инструментов на выборах?

Правовая сфера, касающаяся применения инструментов обнаружения deepfake в политических контекстах, все еще развивается. Возникают вопросы о том, могут ли результаты инструментов, таких как Deepfake Voice Detector, служить юридическими доказательствами недобросовестной практики или дезинформации.

3. Сможет ли детектор справляться с развивающимися технологиями ИИ?

Хотя инструмент Hiya хвалится точностью более 99%, голоса, сгенерированные ИИ, продолжают эволюционировать. Остается вопросом, сможет ли детектор постоянно адаптироваться к новым техникам манипуляции аудио.

Ключевые проблемы и споры

1. Чрезмерная зависимость от технологий для обнаружения дезинформации

Критики утверждают, что такие инструменты, как Deepfake Voice Detector, могут создавать ложное чувство безопасности среди пользователей. Полагание исключительно на технологии без обучения медиаграмотности может помешать людям критически анализировать контент самостоятельно.

2. Потенциал для злоупотреблений

Подобно тому, как deepfake могут ввести в заблуждение, инструменты обнаружения могут быть неправомерно использованы для ложного обвинения легитимного аудиоконтента в манипуляциях, тем самым причиняя ущерб репутациям без должного контекста или расследования.

3. Ограниченная доступность и опыт пользователей

Система ежедневных кредитов для расширения может ограничить доступ для пользователей с высоким спросом, создавая сложность поддержания эффективности, особенно в периоды пиковых дезинформационных атак.

Преимущества и недостатки Hiya Deepfake Voice Detector

Преимущества:

— Высокий уровень точности: С уровнем успеха более 99% инструмент готов значительно сократить случаи попадания в ловушки deepfake аудио.

— Уп empowerment пользователей: Предоставляя прозрачность в отношении подлинности аудио, пользователи могут получить больший контроль над своим медийным потреблением.

— Поддержка информированного принятия решений: В контексте выборов возможность идентифицировать аудио deepfake может привести к более обоснованным решениям избирателей на основе подлинных сообщений кандидатов.

Недостатки:

— Ограниченные кредиты на использование: Обеспокоенность по поводу ограниченных ежедневных кредитов может затруднить широкое принятие, особенно в критические информационные периоды.

— Эволюция технологий deepfake: Поскольку ИИ продолжает развиваться, инструменту могут понадобиться постоянные обновления, чтобы оставаться актуальным, что создает проблемы для устойчивости и ожиданий пользователей.

— Потенциальная самодовольность: Пользователи могут стать чрезмерно зависимыми от технологии, пренебрегая развитием своих критических мыслительных и медиоаналитических навыков.

С приближением сезона выборов внедрение таких инструментов, как Hiya Deepfake Voice Detector, имеет потенциал изменить наше взаимодействие с медиа и политикой, предоставляя новые пути для ответственности и одновременно ставя перед нами новые вызовы в быстро развивающейся цифровой среде.

Для получения дополнительной информации о deepfake и связанных технологиях вы можете посетить MIT Technology Review или ознакомиться с обновлениями и идеями на Wired.