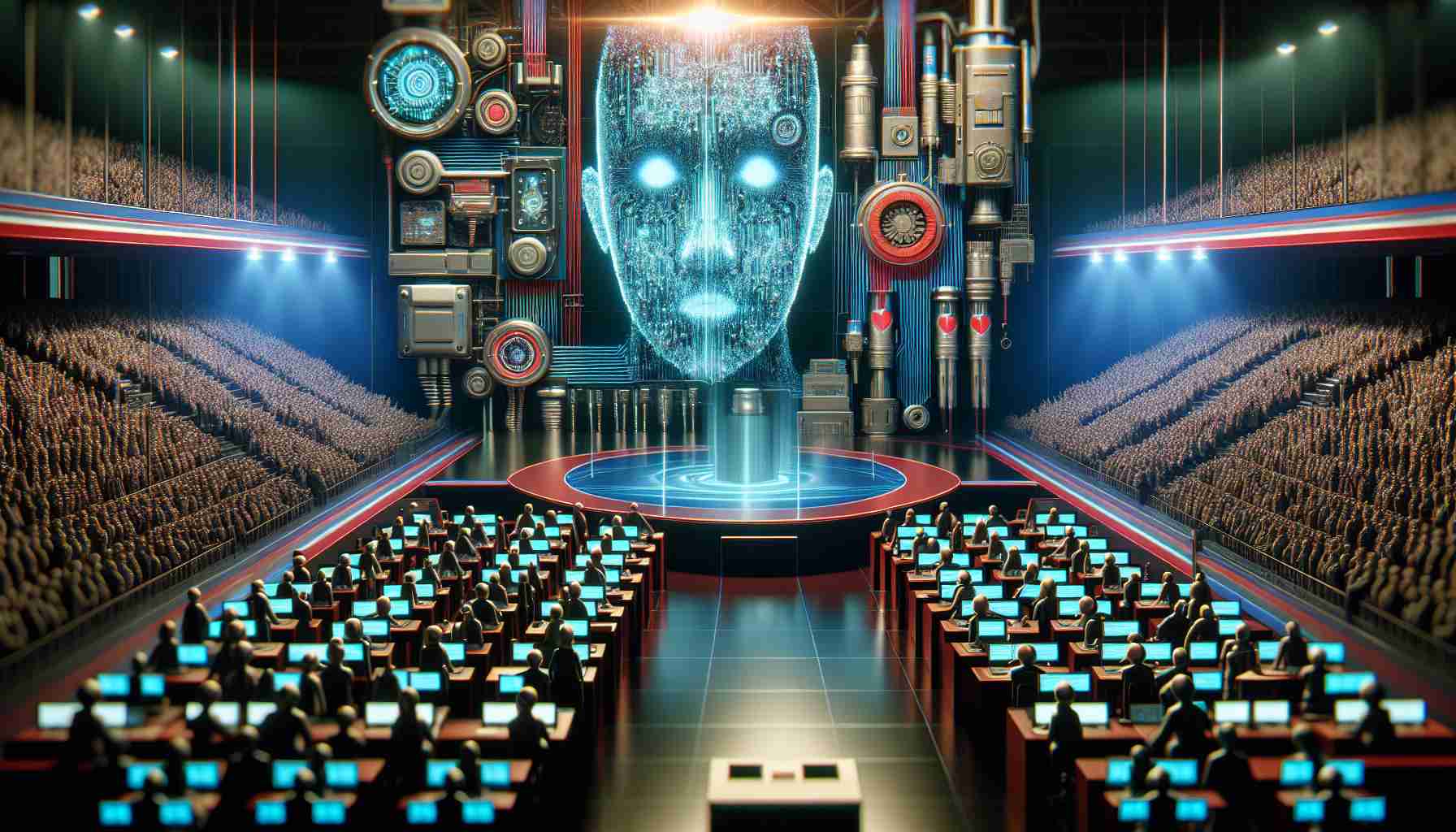

जैसे-जैसे 2024 के अमेरिकी चुनाव करीब आते हैं, गहरे नकली आवाजों की पहचान में एक महत्वपूर्ण प्रगति सामने आई है। Hiya, जो अपनी कॉल स्क्रीनिंग और धोखाधड़ी पहचान क्षमताओं के लिए जानी जाती है, ने एक नि:शुल्क क्रोम एक्सटेंशन पेश किया है, जिसका उद्देश्य उपयोगकर्ताओं को ऑडियो और वीडियो सामग्री में मिली आवाजों की प्रामाणिकता का आकलन करने में मदद करना है। इस एक्सटेंशन का नाम Hiya Deepfake Voice Detector है, जो ऑडियो इनपुट का विश्लेषण करता है और एक स्कोर प्रदान करता है, जो बताता है कि कोई आवाज असली या बनावटी होने की कितनी संभावना है।

Hiya के अनुसार, विस्तृत परीक्षणों से पता चला है कि यह उपकरण 99 प्रतिशत से अधिक प्रभावशाली सटीकता दर का दावा करता है। यह डिटेक्टर हाल की AI तकनीकों से निर्मित आवाजों को पहचान सकता है, भले ही वे मॉडल द्वारा पहले से मिलें न हों।

प्रारंभिक परीक्षणों में, उपयोगकर्ताओं ने पाया कि एक्सटेंशन प्रभावी ढंग से AI-निर्मित आवाजों को उजागर करता है। उदाहरण के लिए, एक लोकप्रिय YouTube वीडियो जिसमें ब्लूज़ किंवदंती हॉव्लिन वुल्फ के बारे में AI-गायन खंड शामिल था, ने कम प्रामाणिकता स्कोर प्राप्त किया, जिसने हेरफेर की आशंकाओं की पुष्टि की।

Hiya के नेतृत्व ने सोशल मीडिया प्लेटफार्मों की आलोचना की है कि वे संभावित रूप से भ्रामक सामग्री के बारे में उपयोगकर्ताओं को चेतावनी देने में पर्याप्त जिम्मेदारी नहीं ले रहे हैं। कंपनी का जोर है कि यह महत्वपूर्ण है कि व्यक्तियों को AI हेरफेर से जुड़े जोखिमों के बारे में जागरूक होना चाहिए और सुरक्षा के लिए उनके Deepfake Voice Detector जैसे उपकरणों का उपयोग करना चाहिए। हालांकि एक्सटेंशन उपयोग को प्रबंधित करने के लिए दैनिक क्रेडिट प्रदान करता है, इसका सीमित कोटा निकट भविष्य में सोशल मीडिया पर आने वाली AI-निर्मित ऑडियो की बाढ़ के साथ बने रहने में संघर्ष कर सकता है।

चुनावों से पहले गहरी नकली आवाजों से निपटने के लिए नया उपकरण जारी: उभरती चुनौतियों का सामना करना

जैसे-जैसे 2024 के अमेरिकी चुनाव नजदीक आते हैं, गहरे नकली तकनीक की वृद्धि राजनीतिक संवाद की सत्यता के लिए महत्वपूर्ण चिंताएं पैदा करती है। इसके जवाब में, Hiya ने अपना Hiya Deepfake Voice Detector पेश किया है, जो न केवल उपयोगकर्ताओं को ऑडियो सामग्री के हेरफेर से बचाने का लक्ष्य रखता है, बल्कि आधुनिक समाज में इस तकनीक के प्रभावों के बारे में प्रासंगिक प्रश्न भी उठाता है।

गहरे नकली तकनीक के चारों ओर महत्वपूर्ण प्रश्न

1. राजनीतिक अभियानों में गहरे नकली तकनीक की व्यापकता कितनी है?

गहरे नकली ऑडियो राजनीतिक संवाद को प्रभावित कर सकता है, उम्मीदवारों के वास्तविक संदेशों पर विश्वास को संभावित रूप से कमजोर कर सकता है। विश्लेषक चुनावों से पहले गहरे नकली उपयोग में वृद्धि की भविष्यवाणी करते हैं, जिससे Hiya के डिटेक्टर जैसे उपकरणों का उपयोग सत्य और नकली के बीच भेद करने के लिए महत्वपूर्ण हो जाएगा।

2. चुनावों में ऐसे उपकरणों के उपयोग के कानूनी परिणाम क्या हैं?

राजनीतिक संदर्भों में गहरे नकली पहचान के उपयोग के आसपास की कानूनीता अभी विकसित हो रही है। यह प्रश्न उठता है कि क्या Deepfake Voice Detector जैसे उपकरणों से प्राप्त निष्कर्षों को गलत काम या भ्रामक जानकारी का कानूनी प्रमाण माना जा सकता है।

3. क्या डिटेक्टर विकसित हो रही AI तकनीकों के साथ कदम मिलाकर चल सकता है?

जबकि Hiya उपकरण 99% से अधिक सटीकता दर का दावा करता है, AI-निर्मित आवाजें लगातार विकसित हो रही हैं। यह देखा जाना बाकी है कि क्या डिटेक्टर लगातार नई ऑडियो हेरफेर तकनीकों के साथ अनुकूलित हो सकता है।

मुख्य चुनौतियों और विवाद

1. भ्रामक जानकारी की पहचान के लिए प्रौद्योगिकी पर अधिक निर्भरता

आलोचकों का कहना है कि Deepfake Voice Detector जैसे उपकरणों से उपयोगकर्ताओं के बीच सुरक्षा का झूठा एहसास हो सकता है। केवल तकनीक पर निर्भर रहना मीडिया साक्षरता शिक्षा के बिना व्यक्तियों को स्वयं सामग्री का आलोचनात्मक विश्लेषण करने में बाधा डाल सकता है।

2. दुरुपयोग की संभावना

जिस तरह गहरे नकली सामग्री भ्रामक हो सकते हैं, पहचान उपकरणों का भी दुरुपयोग किया जा सकता है, जिससे वैध ऑडियो सामग्री को हेरफेर के रूप में गलत तरीके से आरोपित किया जा सके, जिससे उचित संदर्भ या जांच के बिना प्रतिष्ठा को नुकसान पहुंच सकता है।

3. सीमित पहुंच और उपयोगकर्ता अनुभव

एक्सटेंशन के लिए दैनिक क्रेडिट प्रणाली उच्च मांग वाले उपयोगकर्ताओं के लिए पहुंच को सीमित कर सकती है, जिससे विशेष रूप से भ्रामक जानकारी के चरम समय के दौरान प्रभावशीलता बनाए रखना चुनौतीपूर्ण हो जाता है।

Hiya Deepfake Voice Detector के फायदे और नुकसान

फायदे:

– उच्च सटीकता दर: 99% से अधिक सफलता दर के साथ, उपकरण गहरी नकली ऑडियो के शिकार बने जाने की घटनाओं को महत्वपूर्ण रूप से कम करने की स्थिति में है।

– उपयोगकर्ता सशक्तिकरण: ऑडियो प्रामाणिकता के बारे में पारदर्शिता प्रदान करके, उपयोगकर्ता अपनी मीडिया उपभोग पर अधिक नियंत्रण प्राप्त कर सकते हैं।

– जानकारील निर्णय लेना: चुनाव के संदर्भ में, गहरे नकली ऑडियो को पहचानने की क्षमता वास्तविक उम्मीदवार संदेशों के आधार पर अधिक सूचित मतदाता निर्णय लेने की संभावना बना सकती है।

नुकसान:

– सीमित उपयोग क्रेडिट: सीमित दैनिक क्रेडिट के प्रति चिंता व्यापक उपयोग को बाधित कर सकती है, विशेष रूप से महत्वपूर्ण जानकारी के समय के दौरान।

– गहरे नकली तकनीकों का विकास: जैसे-जैसे AI आगे बढ़ता है, उपकरण को प्रासंगिक बने रहने के लिए लगातार अपडेट की आवश्यकता हो सकती है, जो स्थिरता और उपयोगकर्ता अपेक्षाओं के लिए चुनौतियों का सामना कर सकता है।

– संभावित आत्मसंतोष: उपयोगकर्ता प्रौद्योगिकी पर बहुत अधिक निर्भर हो सकते हैं, आलोचनात्मक सोच और मीडिया मूल्यांकन क्षमताओं को सुधारने की अनदेखी कर सकते हैं।

जैसे-जैसे चुनाव का मौसम करीब आता है, Hiya Deepfake Voice Detector जैसे उपकरणों का कार्यान्वयन मीडिया और राजनीति के साथ हमारे जुड़ने के तरीके को आकार देने की क्षमता रखता है, जवाबदेही के लिए नए मार्ग प्रदान करता है जबकि तेजी से विकसित हो रहे डिजिटल परिदृश्य में नई चुनौतियों का सामना करता है।

गहरे नकली और संबंधित तकनीकों के बारे में अधिक जानकारी के लिए, आप MIT Technology Review पर जा सकते हैं या अपडेट और अंतर्दृष्टि के लिए Wired चेक कर सकते हैं।